NAIGC操作手册

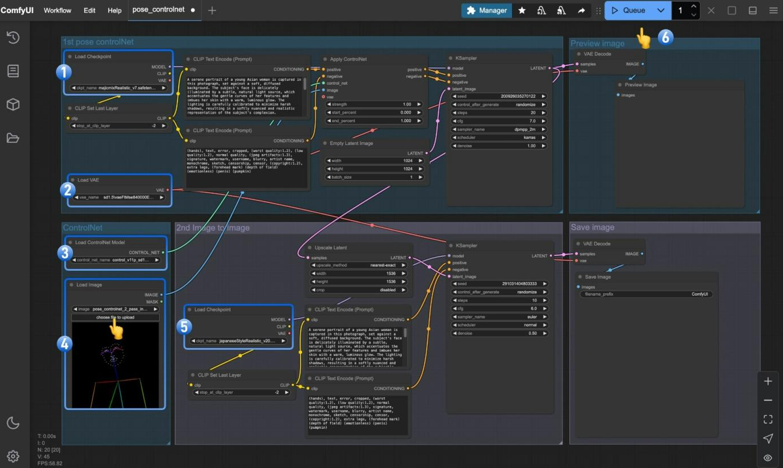

四、基础节点详解

在 AIGC 图像生成系统中,节点并不仅仅是软件中的操作模块,而是构成整个生成逻辑的最小功能单元。理解节点,等同于理解人工智能图像生成的“工作机制”;掌握节点,意味着具备拆解与重构生成流程的能力。

采用节点化、可视化的工作流架构,将原本隐藏在算法与代码中的生成过程,拆解为一个个具有明确输入、输出与职责边界的功能节点。这种结构不仅降低了学习门槛,更使“生成过程”本身成为可分析、可教学、可评估的对象,非常适合应用于职业教育与技能训练场景。

在实际教学与生产中,许多学习者往往直接从“出图效果”入手,却忽视了节点背后所代表的模型结构、数据流向与生成逻辑。这种“结果导向”的使用方式,虽然可以快速获得图像,但难以形成稳定、可迁移的专业能力,也无法支撑复杂项目与真实生产需求。

因此,本章将从基础节点入手,对最核心、最具代表性的节点进行系统梳理与深入解析。通过对节点功能、参数含义及其在整体工作流中所处位置的讲解,帮助学习者建立起对 AIGC 图像生成流程的整体认知,为后续的进阶工作流设计、风格控制、生产级应用与职业能力评价打下坚实基础。

1、图像(Image)

节点功能:该节点用来加载图像。

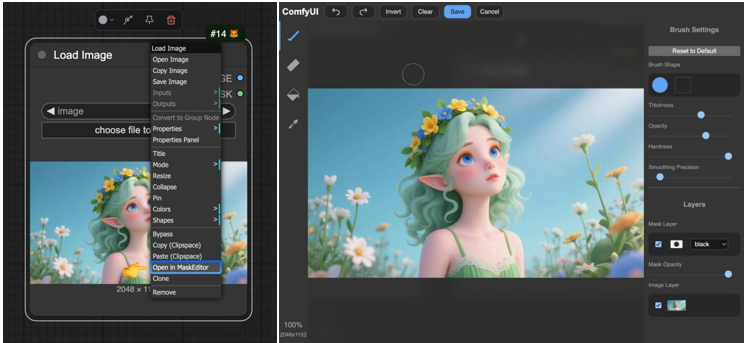

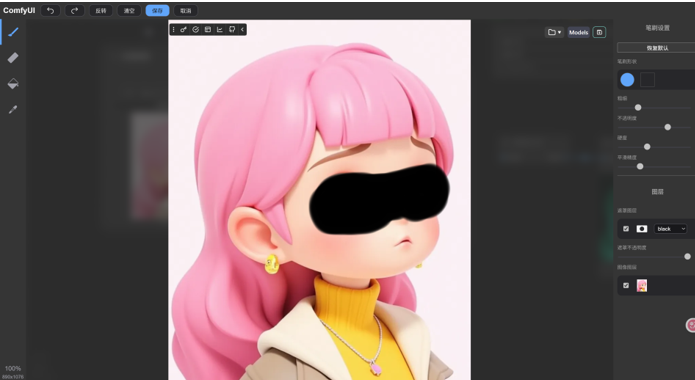

注意:我们可以右键点击图像,选择“在遮罩编辑器中打开”选项,进入右侧蒙版编辑界面。

节点功能:该节点用来预览图像。

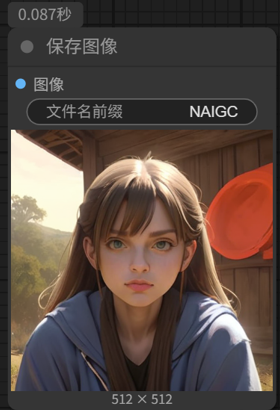

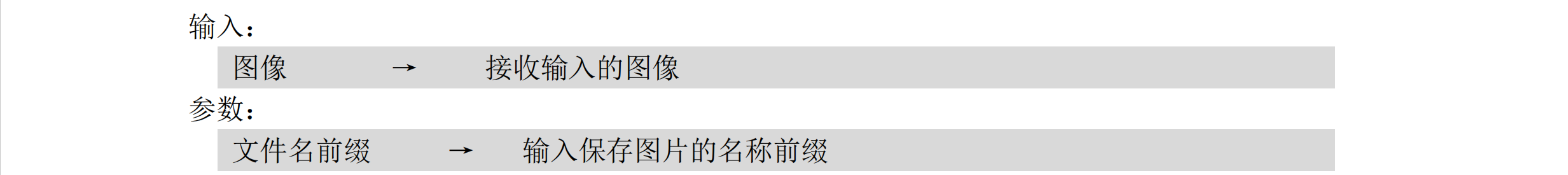

A. 保存图像(Save Image)

节点功能:该节点用来保存图像。

注意:保存图像的路径为当前目录下output文件夹内,这里文件前缀名输入的NAIGC,输出名称为“NAIGC_00001_.PNG”。

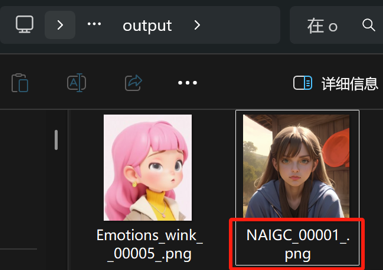

a) 图像缩放(Upscale Image)

节点功能:该节点用于将图片通过基础算法进行分辨率调整。

注意:该方法进行扩展的图像会通过数学计算的方式进行像素的填充,高清修复并非此过程。

注意:该方法进行扩展的图像会通过数学计算的方式进行像素的填充,高清修复并非此过程。

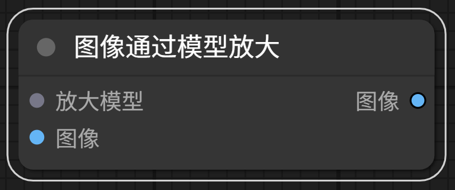

b) 图像通过模型放大(Upscale Image(using Model))

节点功能:该节点用来对图像进行放大,使用model进行图像放大。

注意:放大模型一般自带放大倍率。

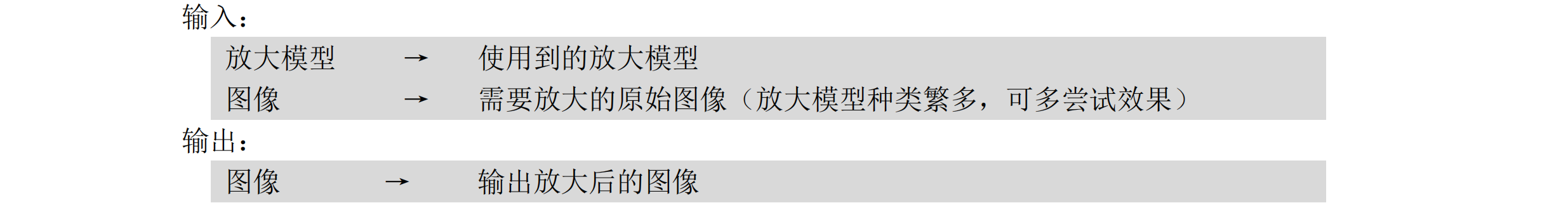

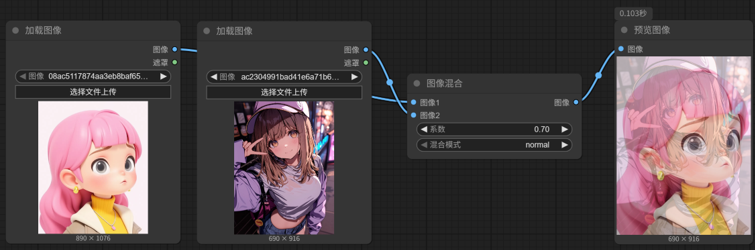

a) 图像混合(Image Blend)

节点功能:该节点通过透明度设置将两张图片进行混合。

应用场景:

通过图像混合(Image Blend)节点,可以灵活地将两幅图像融合在一起,调整混合比例和模式,以实现丰富多样的图像处理效果。

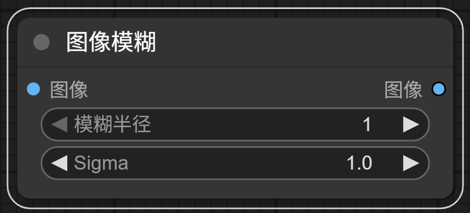

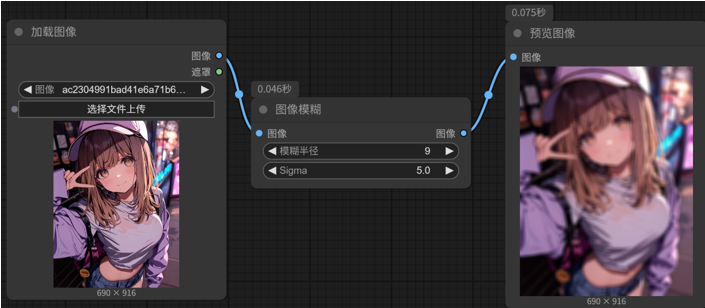

b) 图像模糊(ImageBlur)

节点功能:该节点将输入的图像加上模糊效果。

应用场景:

通过图像模糊(Image Blur )节点,可以根据需求调整图像的外观,使其更符合艺术创作或者设计需求。

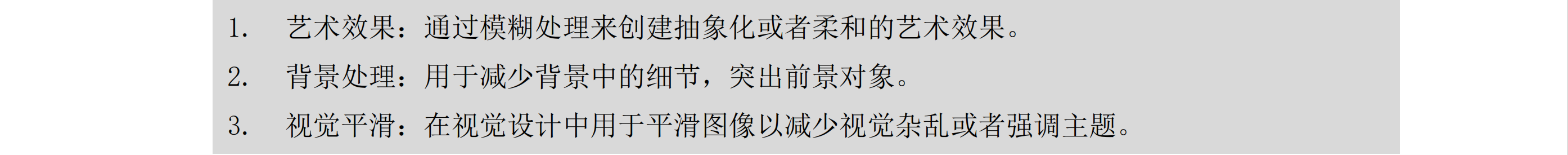

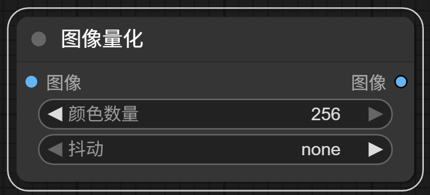

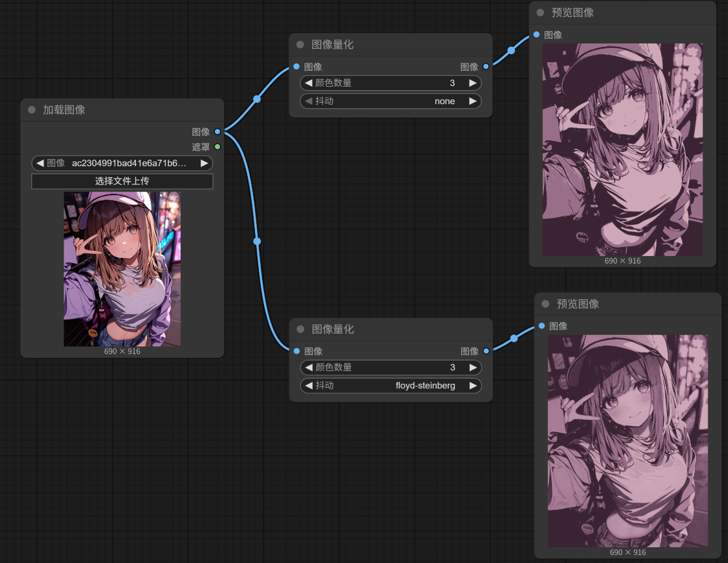

c) 图像量化(ImageQuantize)

节点功能:该节点用于对图像的原始像素范围进行量化调整。

应用场景:

通过图像量化(ImageQuantize)节点,可以调整图像的色彩级别,从而控制图像的视觉表现和处理效率。

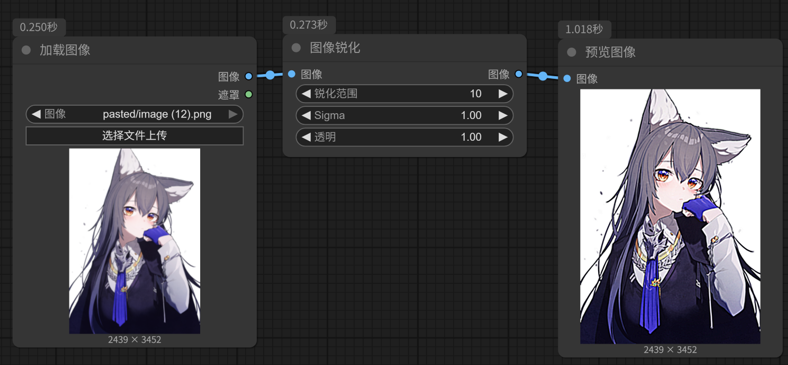

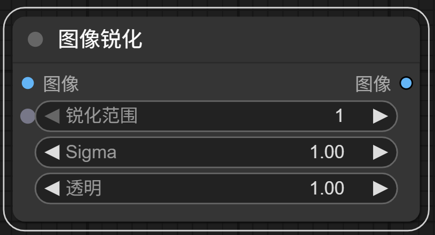

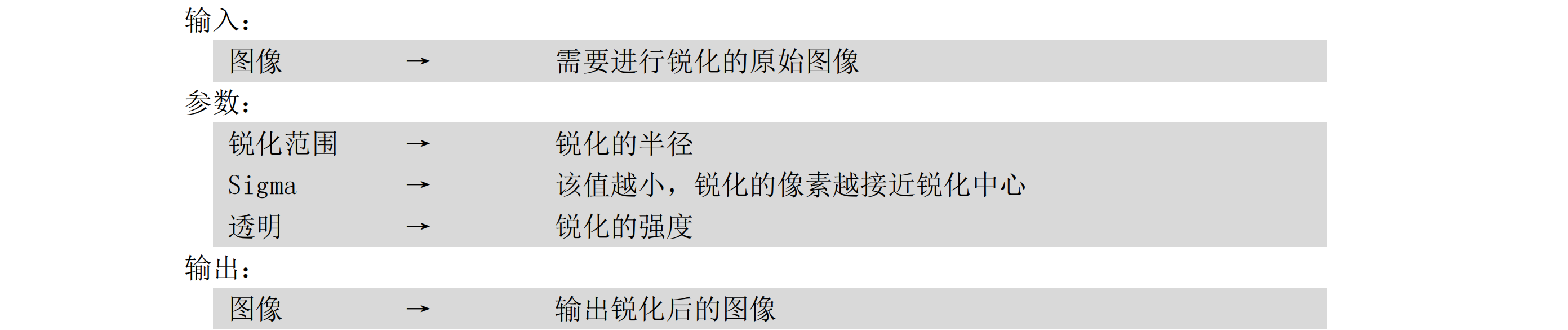

d) 图像锐化(ImageSharpen)

节点功能:该节点对原始图像增加锐化。

通过 图像锐化(Image Sharpen) 节点,可以定制化地调整图像的清晰度和细节,以满足不同的美学和功能需求。

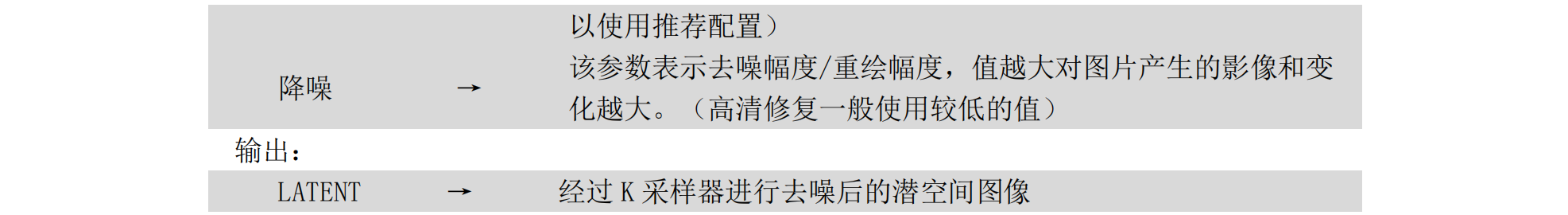

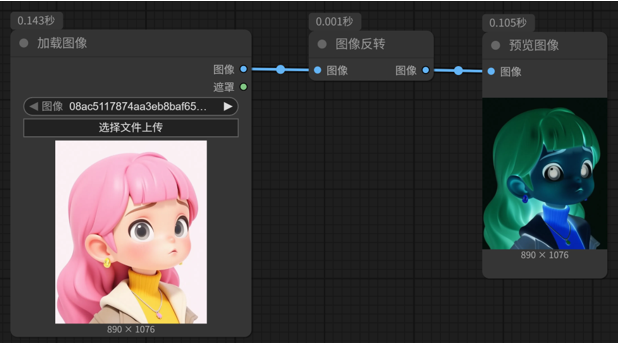

节点功能:该节点用来对图像进行颜色反转,制作负片效果。

注意:在色轮中,每个颜色都存在一个补色,该节点的作用就是把原图中的颜色转换为对应的补色。

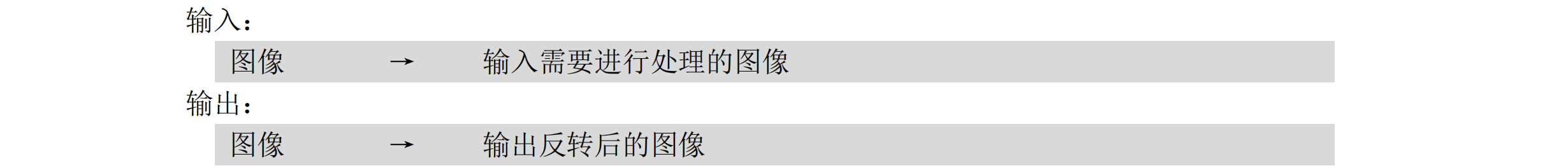

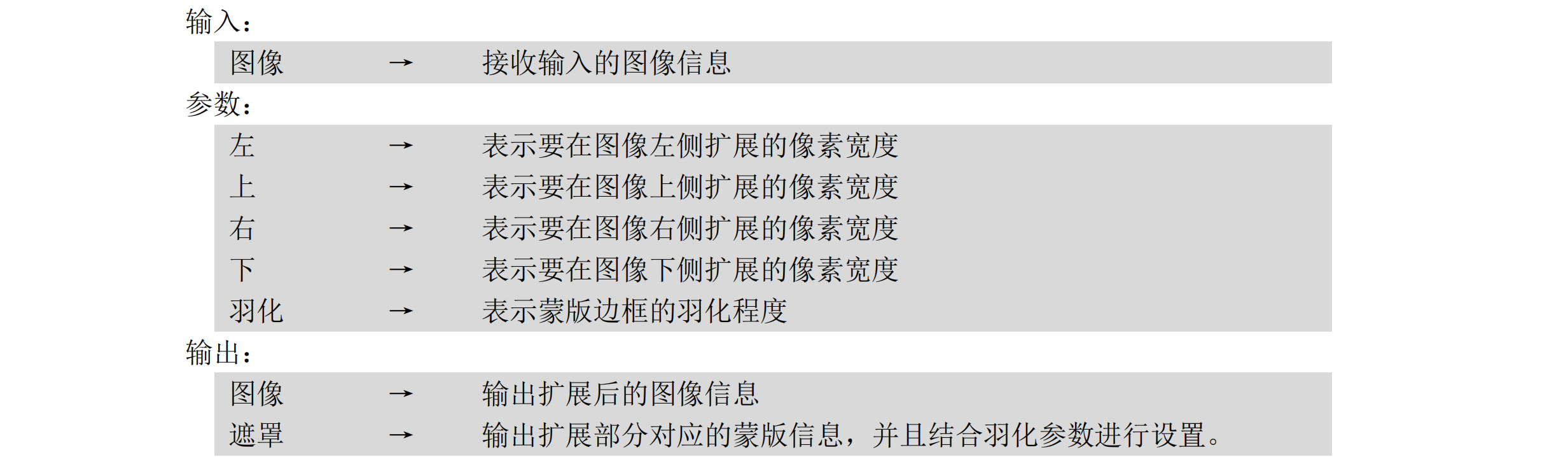

节点功能:该节点用来扩充现有画布的尺寸。

注意:如图所示,将遮罩转为图像后进行输出,可以看到羽化的值影像的是模板边缘的羽化值。该扩图方式一般配合VAE Encode For Inpaint Frames ∞Mixlab使用。

2、潜空间数据(LATENT)

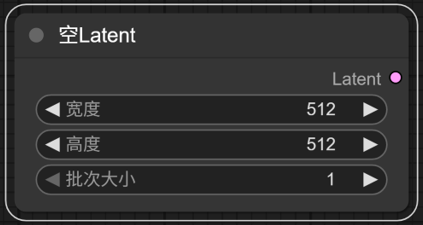

节点功能:该节点用来生成纯噪声的潜空间图像,并设置图像的比例。

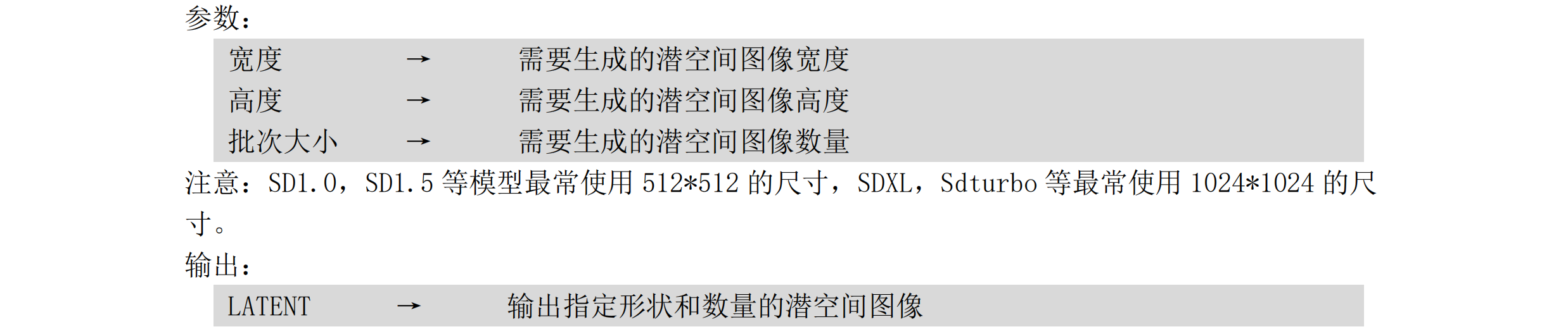

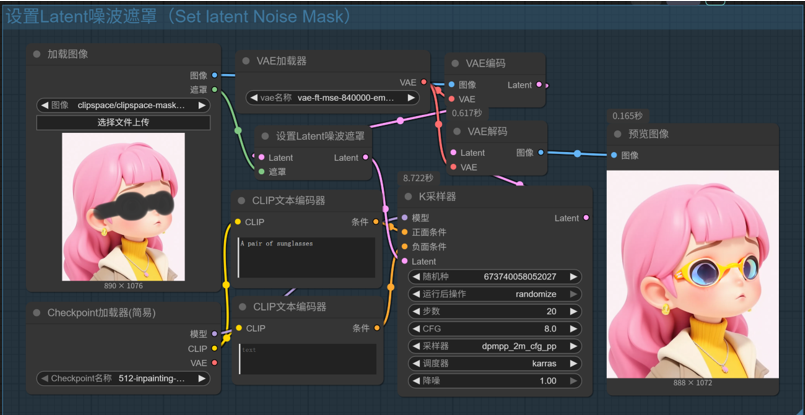

节点功能:该节点对潜空间图像增加蒙版,从而控制扩散区域

注意:因为该设置传入的蒙版并没有羽化的操作,所以会导致蒙版区域的扩散和原始图的融合度很低,不建议使用。

![]()

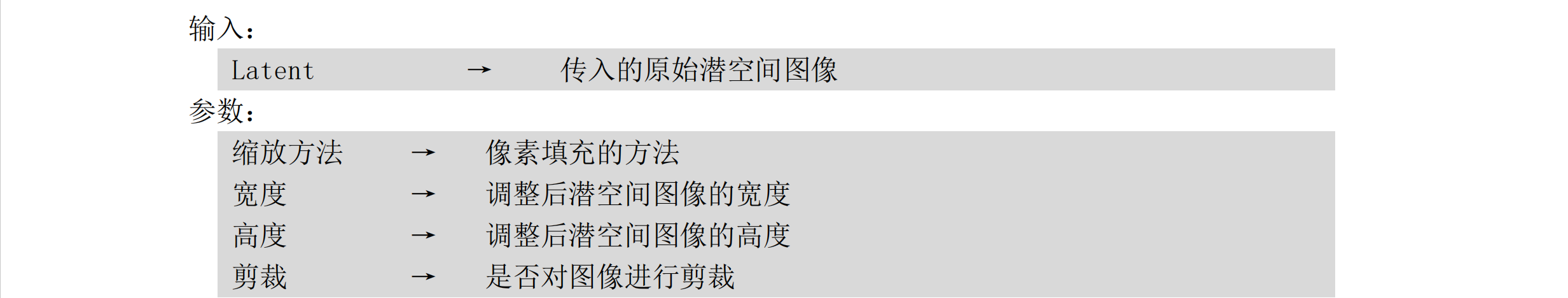

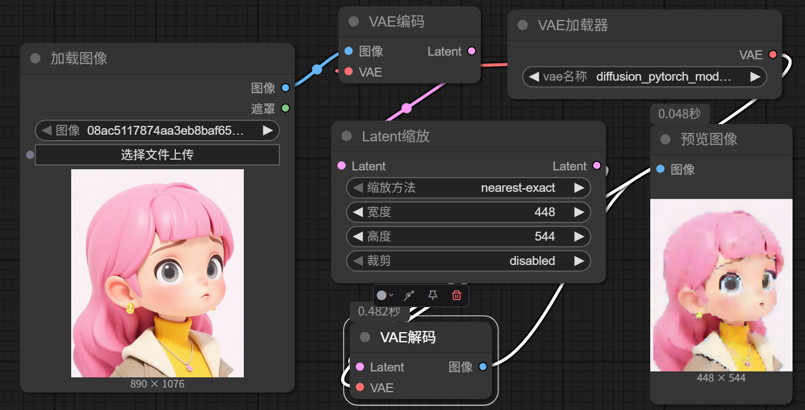

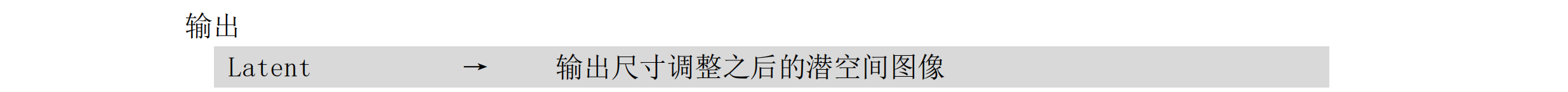

节点功能:该节点对潜空间图像进行分辨率调整,仅使用数学方式进行像素填充。

注意:潜空间图像的方法并不会很完美的融合图像,通过VAE解码后会出现毁坏的情况,正确的做法是使用K采样器进行二次采样,从而使得图像更加的美观。

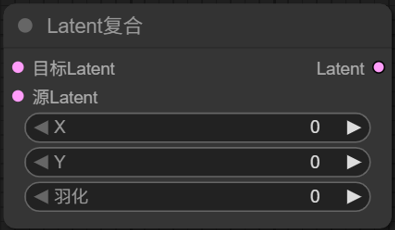

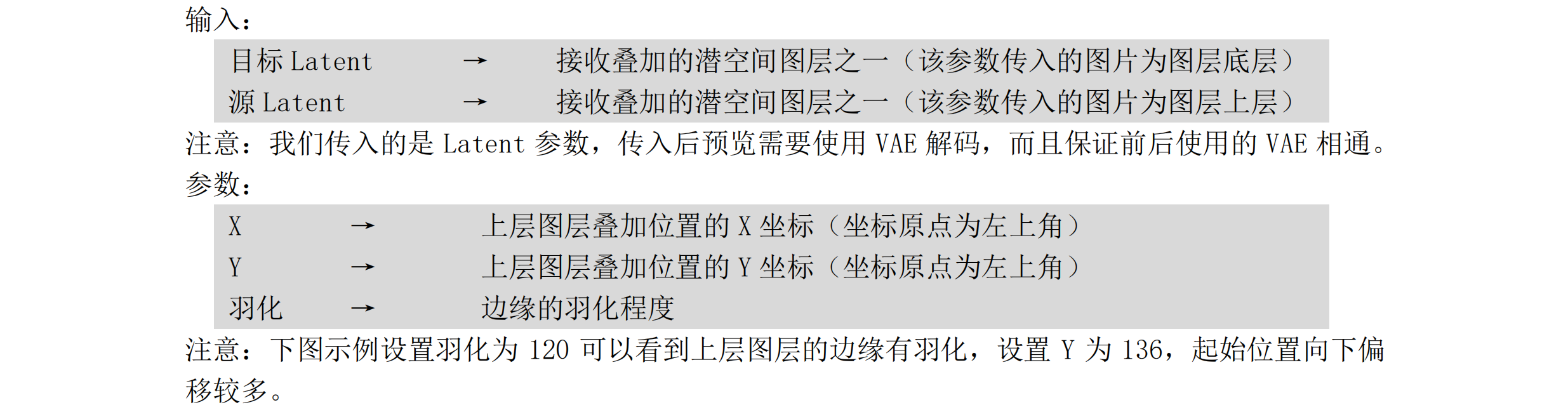

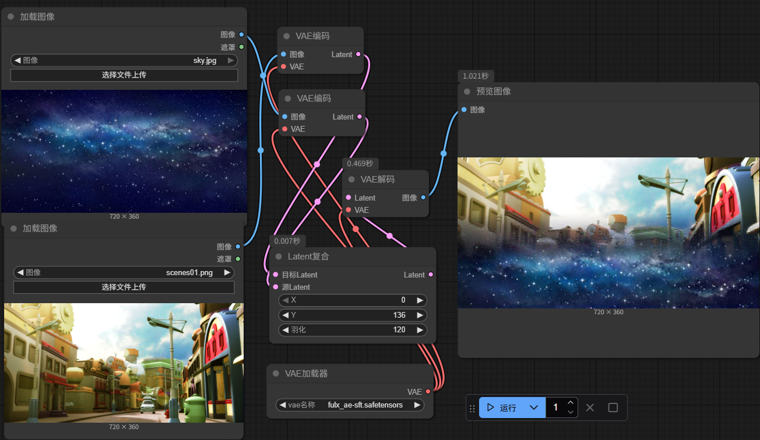

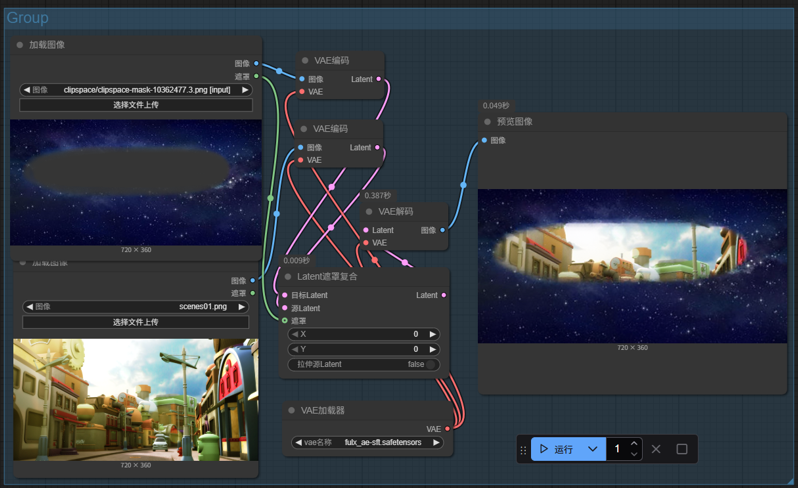

节点功能:该节点类似于图像叠加节点,区别在于这个潜空间对图层进行叠加。

节点功能:该节点将Latent图像进行叠加,但是上层图像可以通过蒙版进行选择性粘贴。

注意:如下图所示,在源Latent图像中给出蒙版信息,传入LatentCompositeMasked节点,用来限制粘贴区域,后续经过VAE解码得到图像,仅粘贴了蒙版区域。

3、CLIP(Contrastive Language–Image Pretraining)

是一个典型的多模态对齐模型,由两个相互独立但共享语义空间的编码器构成:

模块 | 功能 | 在 ComfyUI 中的体现 |

文本编码器(Text Encoder) | 文本 → 语义向量 | Checkpoint 中自带的 CLIP 文本部分 |

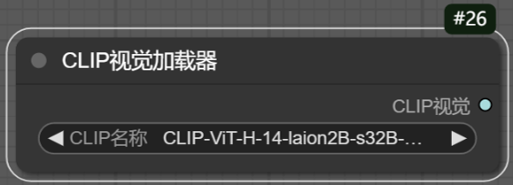

视觉编码器(Vision Encoder) | 图像 → 语义向量 | 加载 CLIP 视觉 节点 |

二者的输出位于同一语义空间,这是“图文对齐”“图像提示”“风格参考”等高级应用的基础。

| 维度 | CLIP Text | CLIP Vision |

| 核心功能 | 将文本提示词(Prompt)转为语义向量 | 将图像转为语义向量(Embedding) |

| 输入类型 | 文字描述(Prompt) | 图像或参考图 |

| 输出 | 文本语义向量 | 图像语义向量 |

| 作用 | 提供文本条件,指导生成模型理解文字意图 | 提供视觉条件,指导生成模型理解图像语义 |

| 使用场景 | 文生图(Text-to-Image)、Prompt Engineering | 图像提示(Image Prompt)、IP-Adapter、风格/构图参考 |

| 在 ComfyUI 中对应节点 | Checkpoint 中自带的文本编码器 | 加载 CLIP 视觉(Load CLIP Vision) |

| 对齐方式 | 与图像语义向量对齐在同一语义空间 | 与文本语义向量对齐在同一语义空间 |

| 本质 | 理解文字 | 理解图像 |

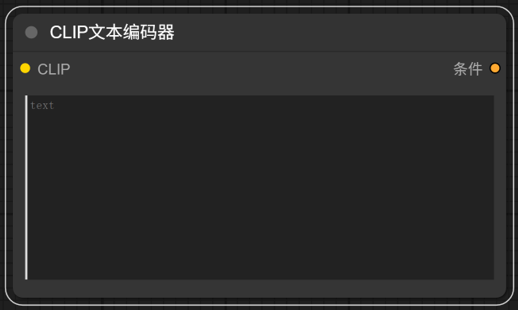

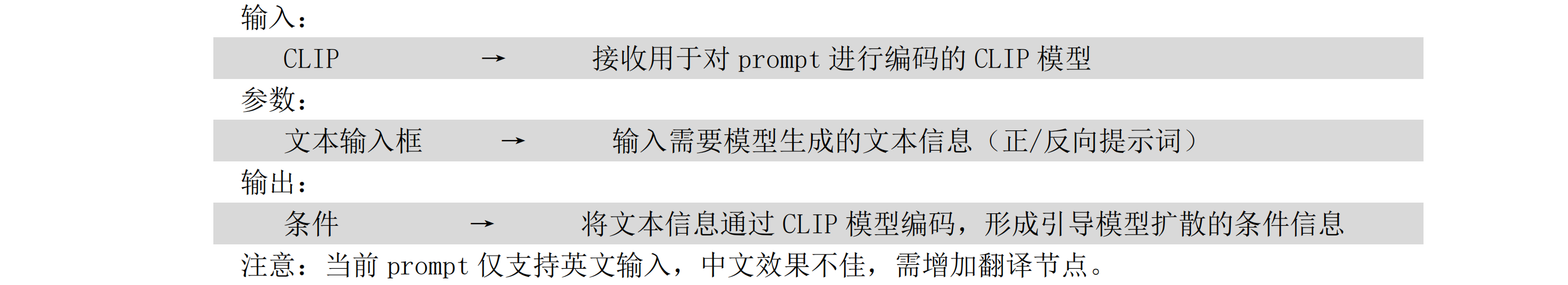

节点功能:该节点用来输入正反向提示词,“文生图”、“文生视频”、“文生音乐”等场景中,录入文字内容的窗口。

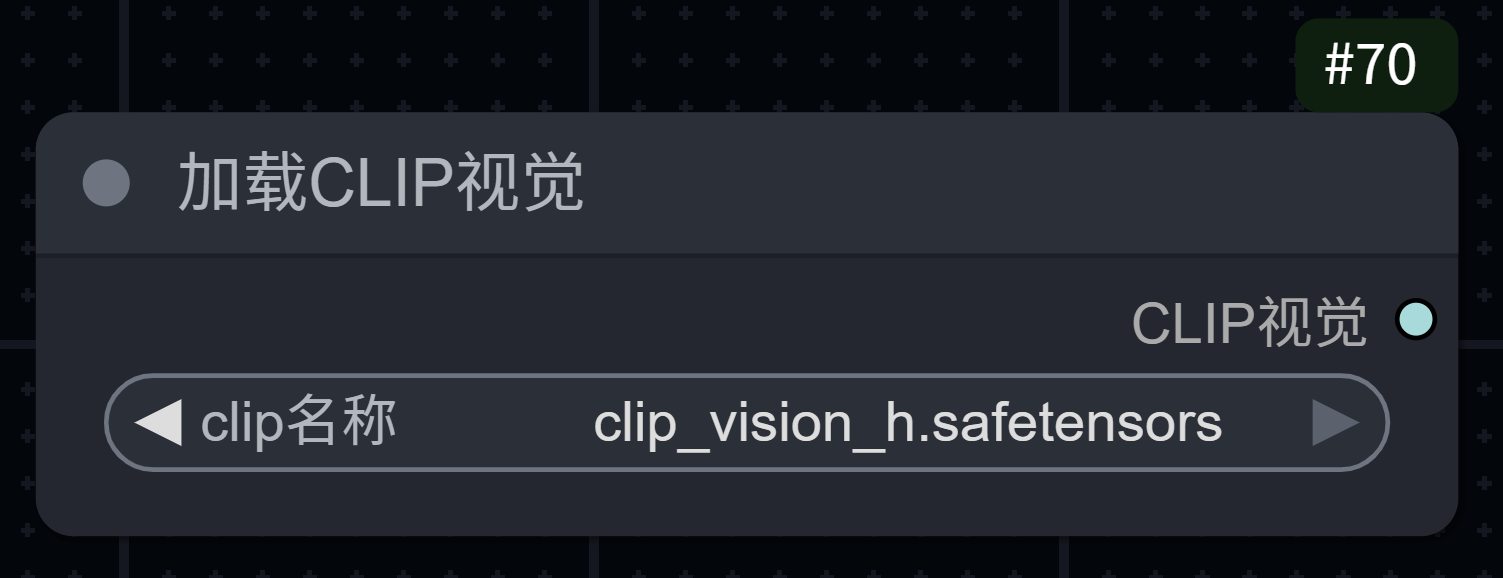

该节点负责“看懂图片”,把图像转化为语义向量,供后续多模态生成节点使用。加载 CLIP 视觉(Load CLIP Vision) 是 ComfyUI 中用于加载 CLIP 模型的视觉编码器(Vision Encoder)的基础节点。该节点的核心作用并非生成图像,而是将输入图像转换为可被模型理解和计算的“视觉语义特征”。

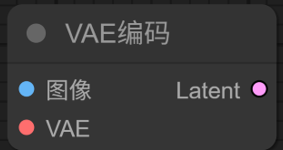

4、VAE(变分自编码器)

VAE(变分自编码器) 是一种神经网络,用于在图像空间和潜空间(latent space)之间互相转换:

l 编码(Encode):把像素图像压缩为潜在表示(latent tensor)。

l 解码(Decode):把潜在表示重新转换成可见的图像。

这种转换在生成流程中非常关键,因为模型内部处理的是潜空间数据,而最终输出要变回图片。

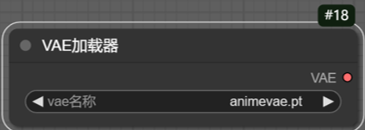

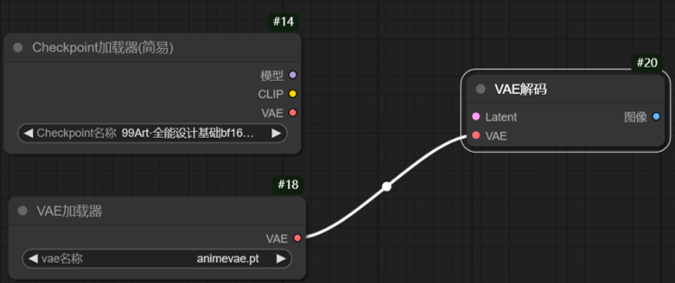

节点功能:加载一个 VAE 模型文件,输出一个 VAE 类型对象 供其它节点使用(Encode / Decode 等)。必要时须加载正确的 VAE,否则解码出来的图片颜色、对比度可能异常(比如颜色偏移、噪点等)。

例如我们添加了一个节点,如果你不想用大语言模型的自带VAE那么就可以自己单独新建一个VAE加载器加载VAE。

节点功能:将像素图像转换为潜空间表示(latent tensor)。适用于图像到潜空间的转换,比如用于 img2img、inpainting(内补)等。

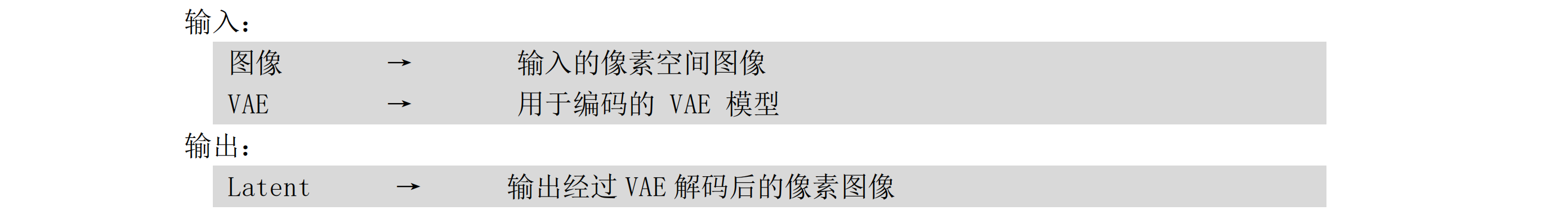

节点功能:该节点用来将潜空间图像解码为像素图像。

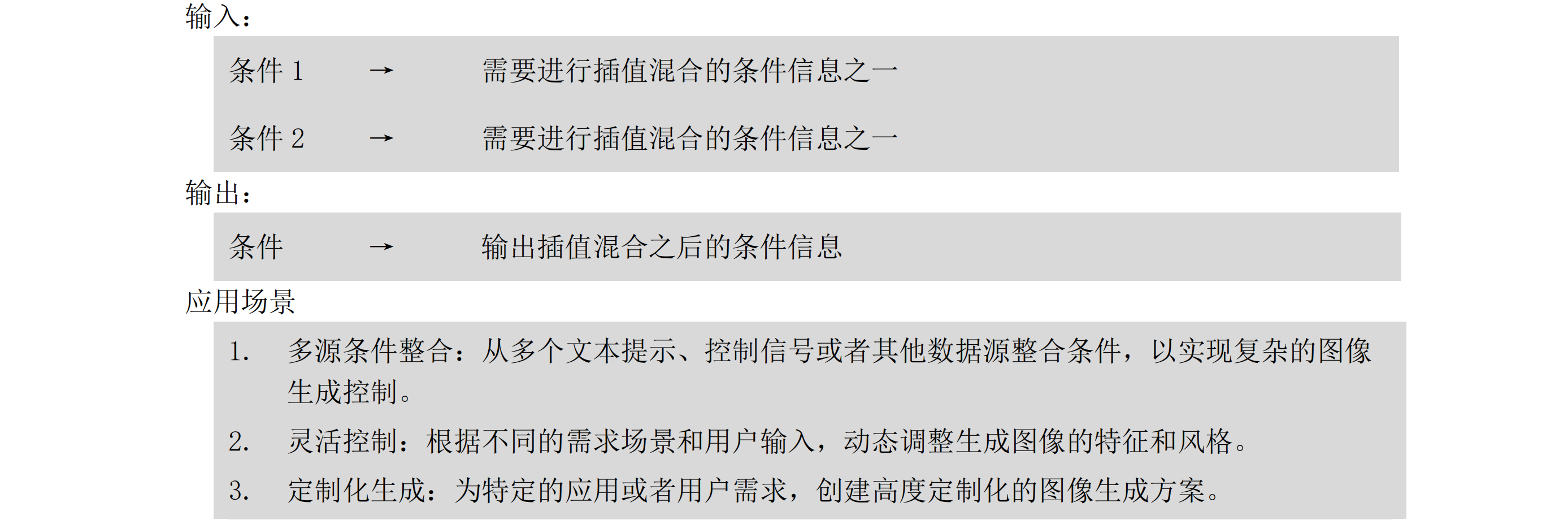

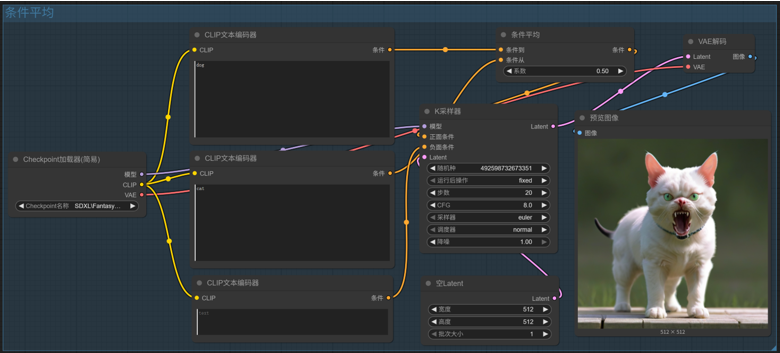

5、条件(conditioning)

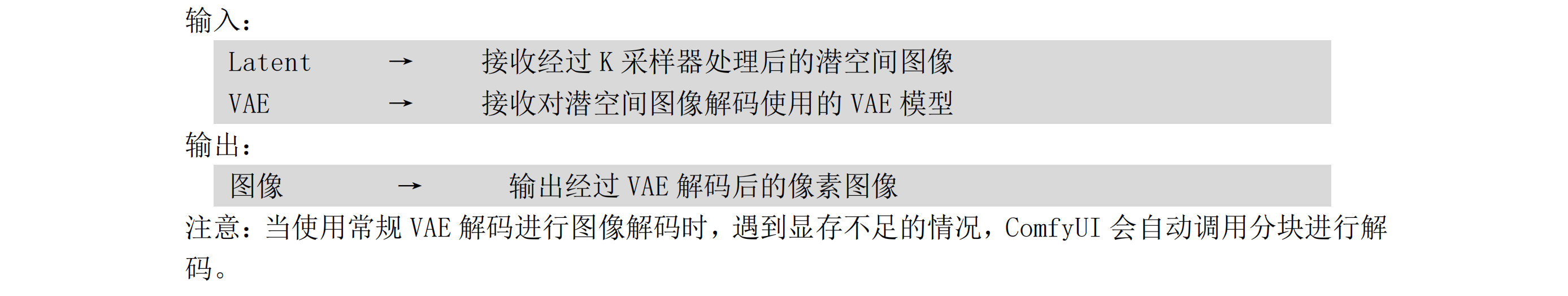

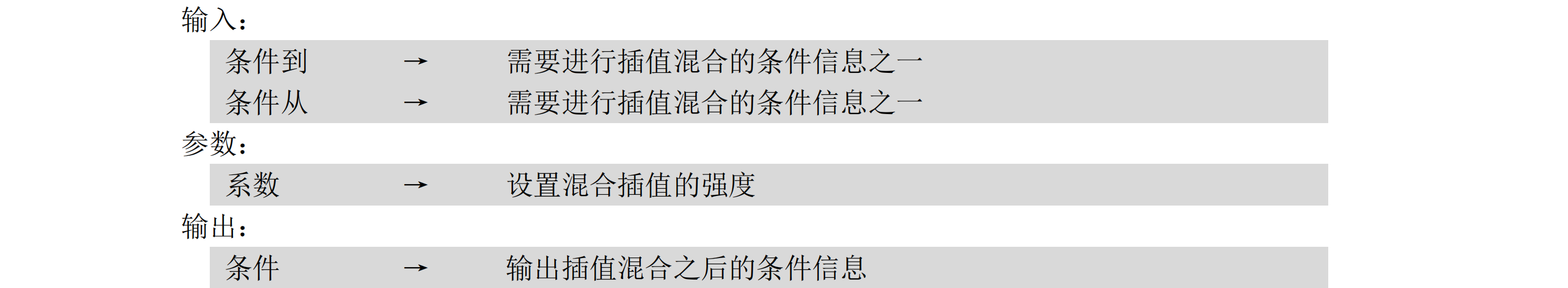

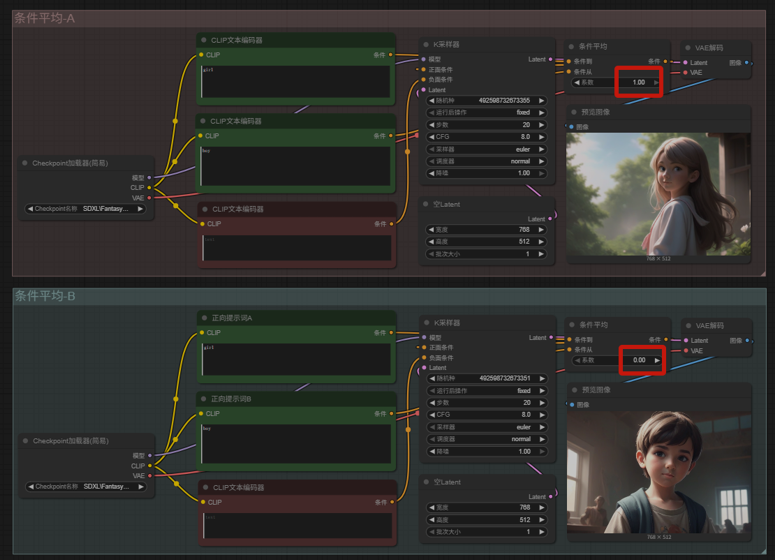

节点功能:该节点根据强度因子对两个文本的条件信息进行插值混合。

注意:当系数为 1 时,图像生成过程将完全受到“条件到(conditioning_to)”的影响,而“条件从(conditioning_ from)”的影响将被忽略。反之,当系数为 0 时,图像生成将只受“条件从(conditioning_ from)”的影响,“条件到(conditioning_to)”的影响则不会起作用。

注意:当系数为 0.5 时,图像生成的结果将会受到“条件到(conditioning_to)”和“条件从(conditioning_ from)”两个条件的影响,它们的权重相等。这种情况下,生成的图像可能会展现出两个条件之间的竞争或者混合的特征。例如,在一个包含"green"和"dragon"这两个条件的情境中,生成的图像可能会显示出这两种特征的一种效果或者混合的效果。

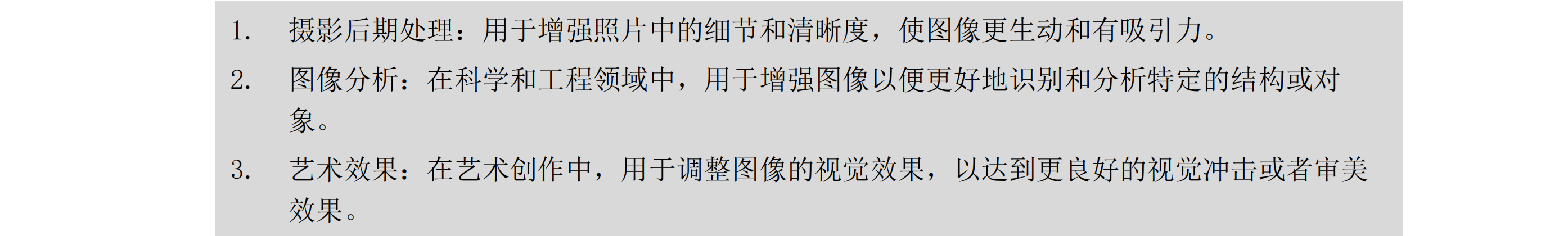

应用场景:

通过条件平均(ConditioningAverage)节点,用户可以灵活地组合多个条件输入,提高图像生成的多样性和灵活性。

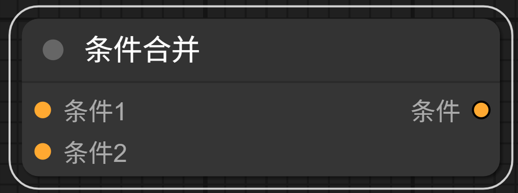

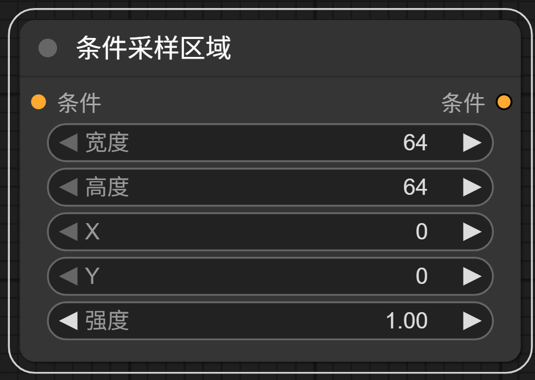

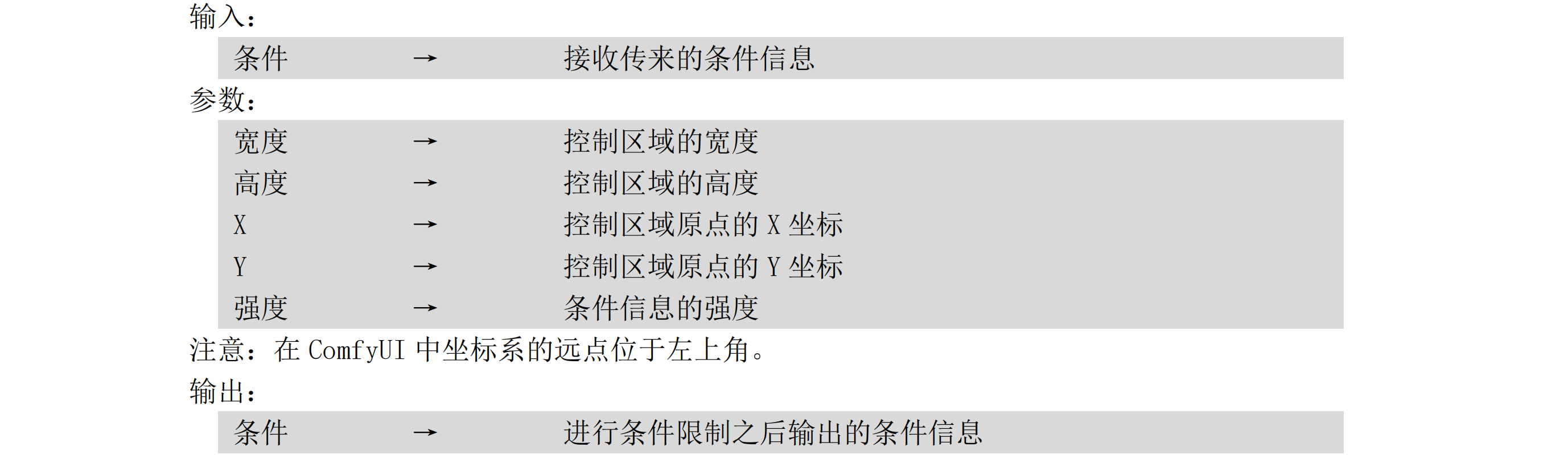

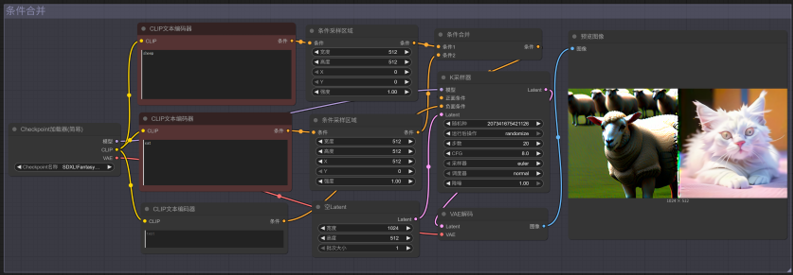

节点功能:该节点用来将条件的影响区域设置在图像的固定范围内,与条件合并Conditioning(Combine)节点合作使用。

应用场景

通过条件采样区域(Conditioning(Set Area))节点,可以精确控制图像生成过程中特定区域的表现,从而增强生成图像的定制性和表现力。

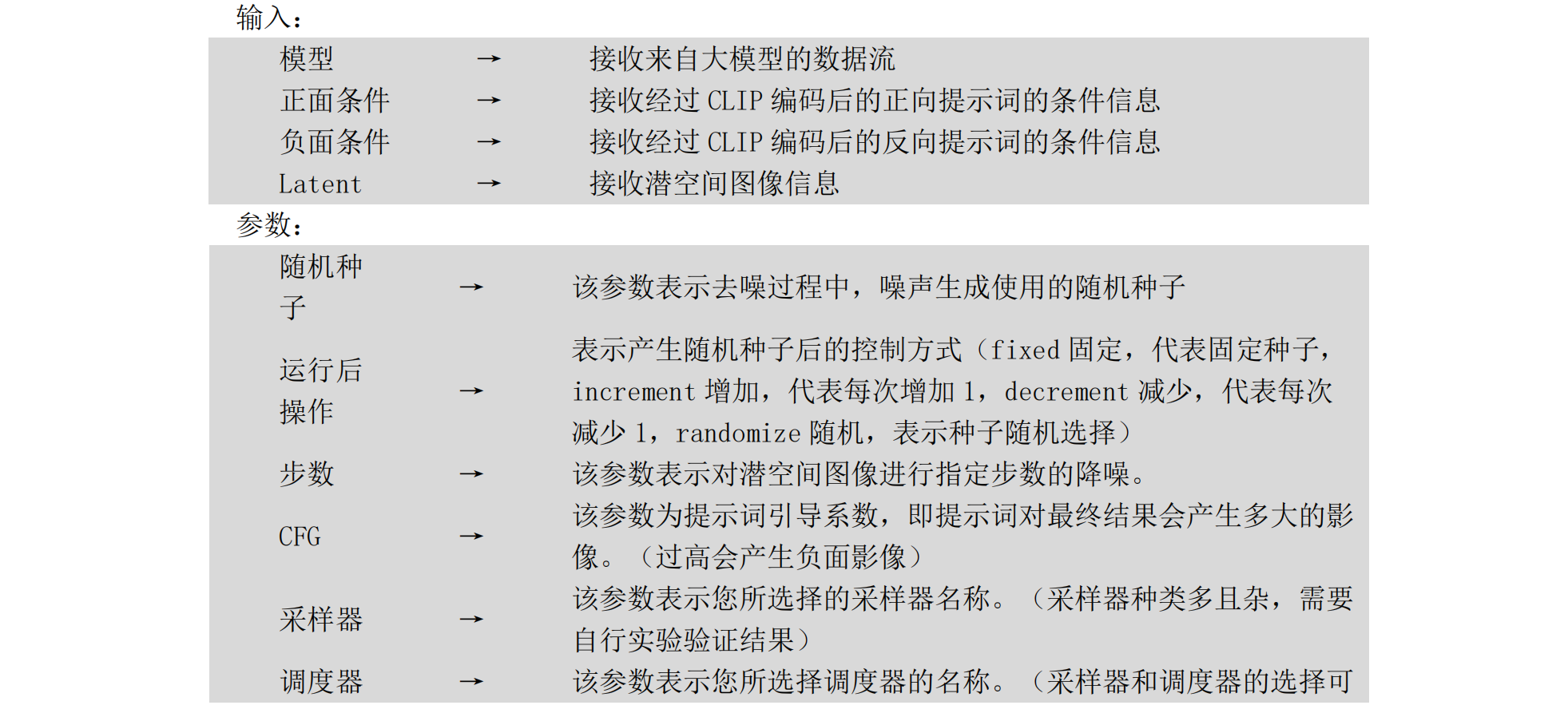

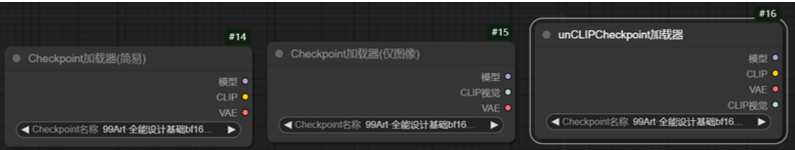

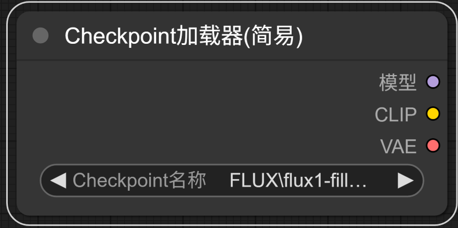

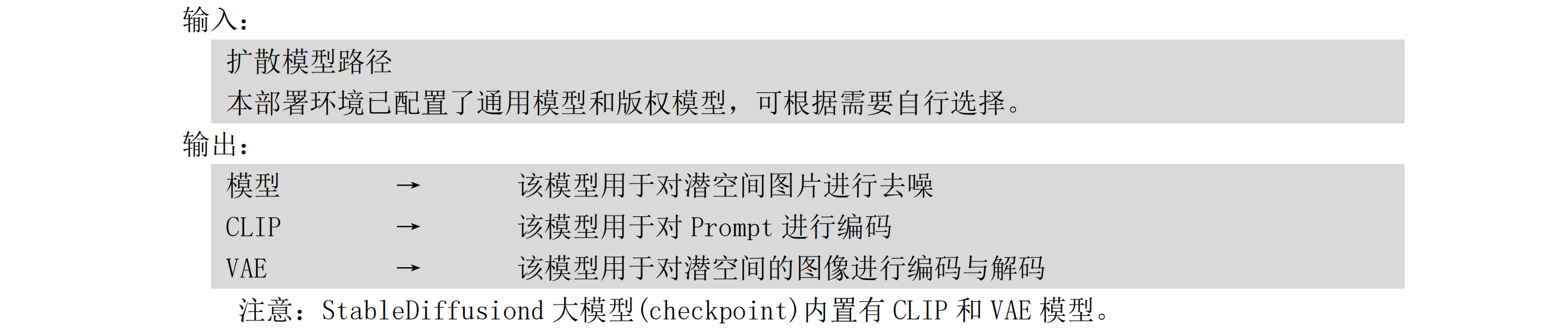

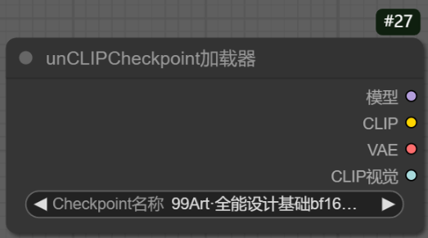

6、Checkpoint加载器

原生的Checkpoint加载器一共有三个,他们都有什么区别呢?

节点功能:该节点用来加载Checkpoint大模型,常用的大模型有sd系列,Flux系列等等。这个应该是你用的最多的加载器了,它的主要功能是用来加载绘画大模型。

这个加载器与简易的相比CLIP变为了CLIP视觉,CLIP视觉接口是视频生成专用接口,专门用来进行视频输入。

专门用来加载UNclip大模型的,我们目前主要用的模型为Latent Diffusion模型。

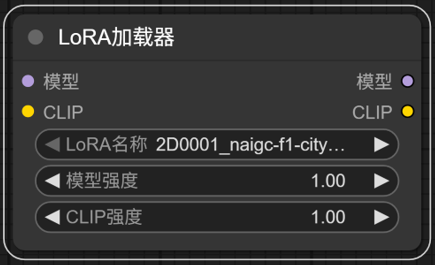

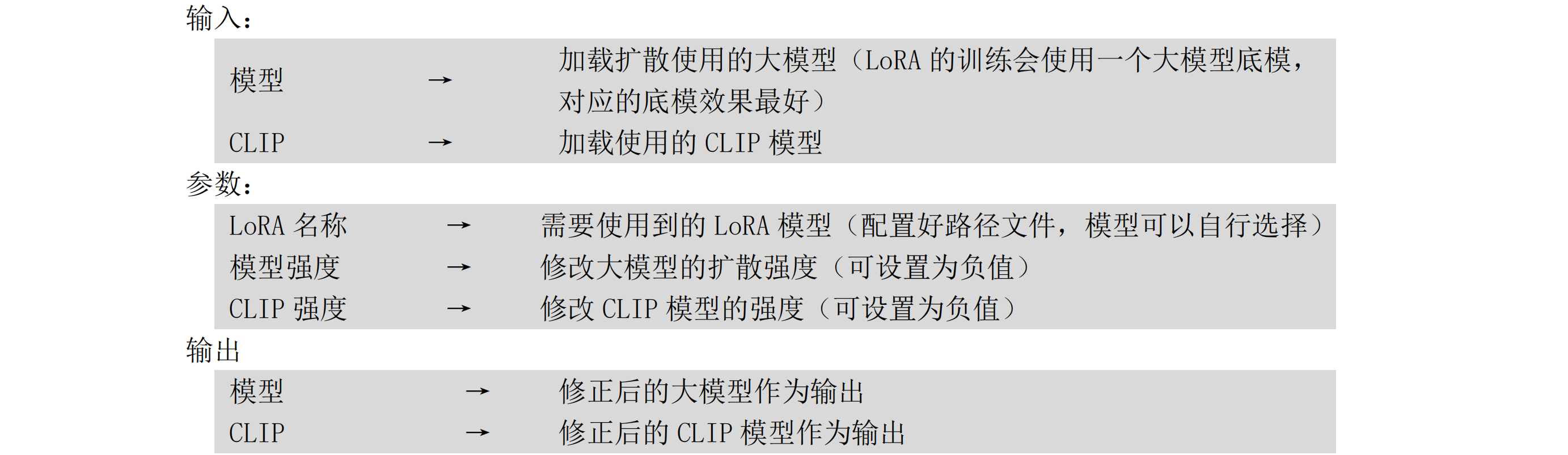

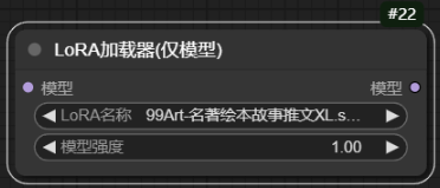

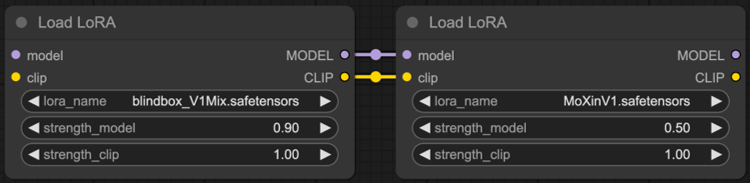

7、Lora加载器

节点功能:该节点加载LoRA模型,并且设置LoRA模型的权重。这里可以加载各种lora模型,同时你可以手动调节模型强度和CLIP强度。

多重 LoRA

8、Controlnet加载器

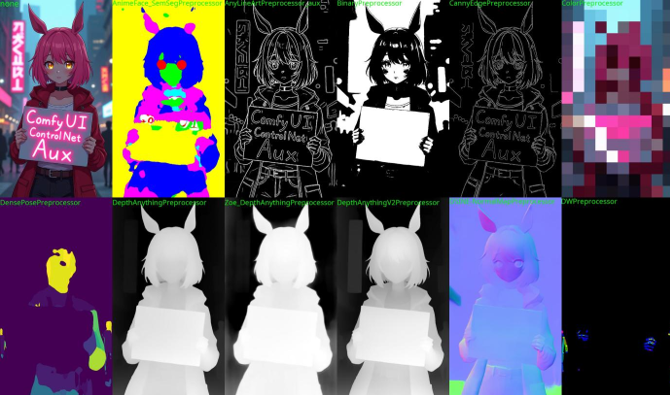

ControlNet模型通过引入多模输入条件,显著提升了图像生成的可控性和细节再现能力,如边缘检测图、深度图和姿态关键点。

这些条件约束使图像生成更可控,允许在绘图过程中同时使用多个ControlNet模型以获得更好的结果。

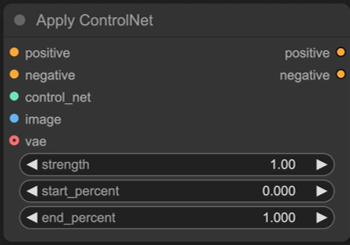

节点功能:该节用来控制加入的ControlNet模型,进而控制图片去噪过程。该节点将多个ControlNet预处理结果(如边缘图、深度图、姿态骨骼图等)同时作用于生成过程,实现对构图、结构、细节的精细化引导。

该节点可加载ControlNet模型,并根据输入图像生成相应的控制条件。

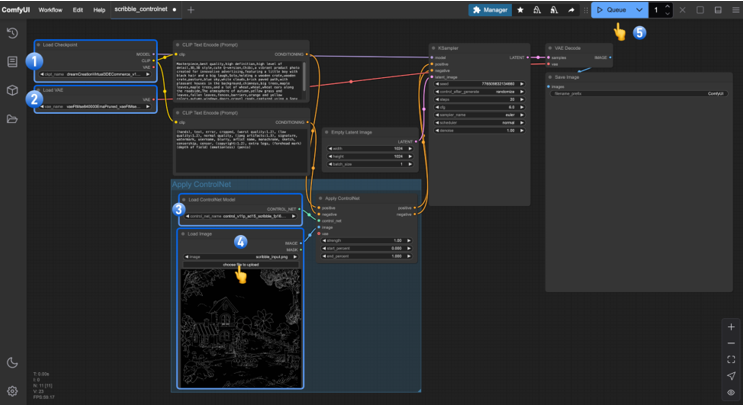

1.确保能加载dreamCreationVirtual3DECommerce_v10.安全张量Load Checkpoint

2.确保能够加载vae-ft-mse-840000-ema-pruned.safetensorsLoad VAE

3.点击节点上传之前提供的输入图像UploadLoad Image

4.确保能够加载control_v11p_sd15_scribble_fp16.安全张量Load ControlNet

5.点击按钮或使用快捷键执行图像生成QueueCtrl(cmd) + Enter

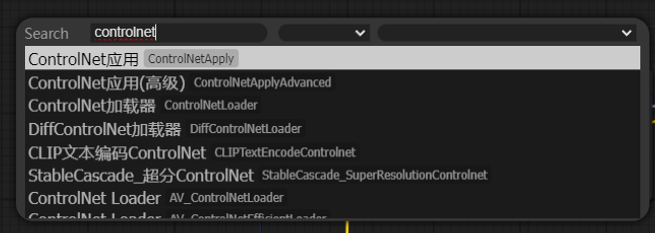

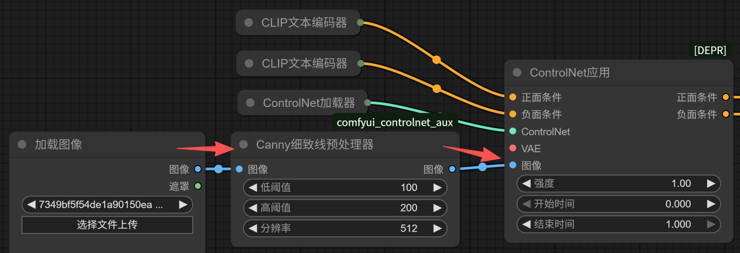

首先双击空白区域搜索controlnet将插件节点调出

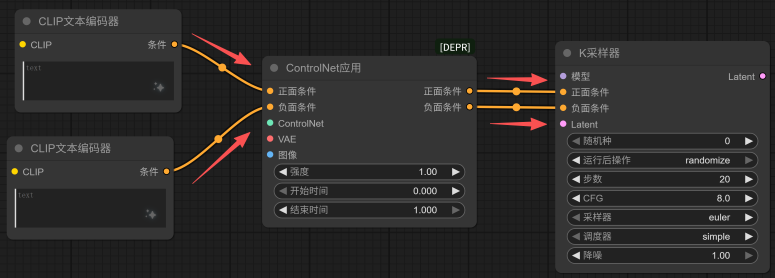

controlnet的前置接口是正负面条件

因此我们可以根据这个找上一个接点,发现正向提示词上也有条件,所以可以得出controlnet节点是接在正向提示词之后的。

拖拽接口然后松开就可以在接口上新建节点了

如上图我们新建了一个controlnet加载器。

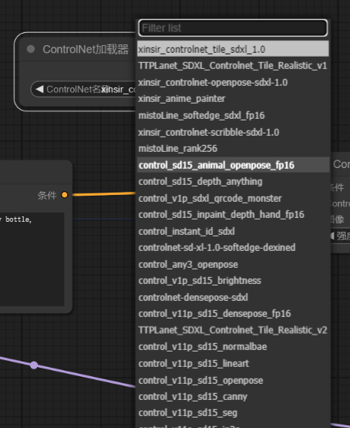

那么在这个加载器中我们就可以使用controlnet模型。

模型加载好了,我们还需要添加一个预处理器处理图像。

双击空白地方添加一个canny预处理器出来,然后拖拽图像接口添加加载图像,然后连接

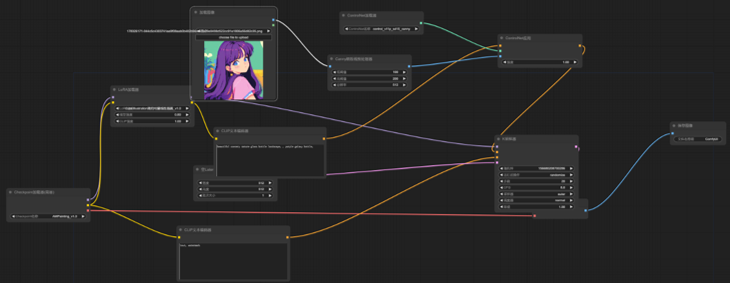

这样我们的一个加载lora并有controlnet的工作流就搭建好了

上传一张参考图测试一下,可以正常运行

我们可以将工作流保存方便下次使用。

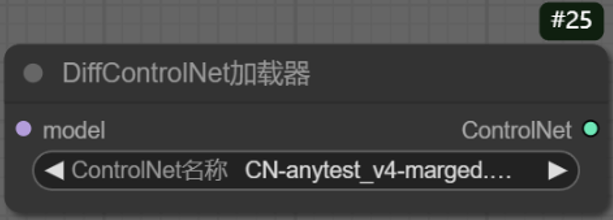

这个是controlnet加载器的进阶版本,前面多了一个大模型的输入接口,这个加载器对于第三方开发的controlnet模型会更友好一些。

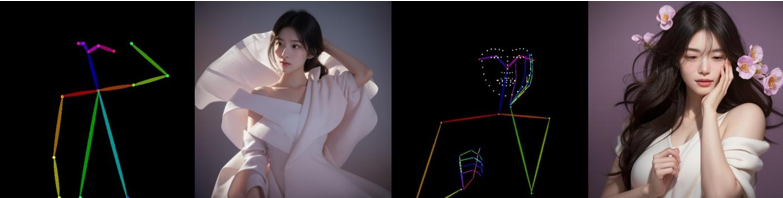

OpenPose可以同时检测图像中的多个人物,捕捉:

A.身体骨骼:18个关键点,包括头部、肩膀、肘部、手腕、臀部、膝盖和脚踝

B.面部表情:70个捕捉微表情和面部轮廓的关键点

C.手部细节:21个手部关键点,用于精确表达手指位置和手势

D.足姿:6英尺关键点,记录站立姿势和动作细节

A.确保它能加载majicmixRealistic_v7.安全张量Load Checkpoint

B.确保能够加载vae-ft-mse-840000-ema-pruned.safetensorsLoad VAE

C.确保能够加载control_v11p_sd15_openpose_fp16.安全张量Load ControlNet Model

D.点击节点中的选择按钮上传之前提供的姿势输入图像,或者使用你自己的OpenPose骨架映射Load Image

E.确保能够加载japaneseStyleRealistic_v20.安全张量Load Checkpoint

F.点击按钮或使用快捷键执行图像生成QueueCtrl(cmd) + Enter

9、Clip视觉加载器

专门用来加载clip视觉模型的,clip视觉模型可以学习参考图的风格

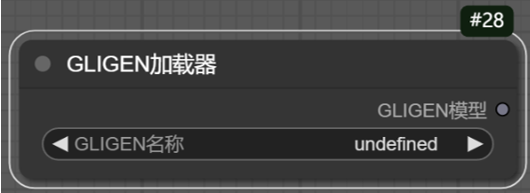

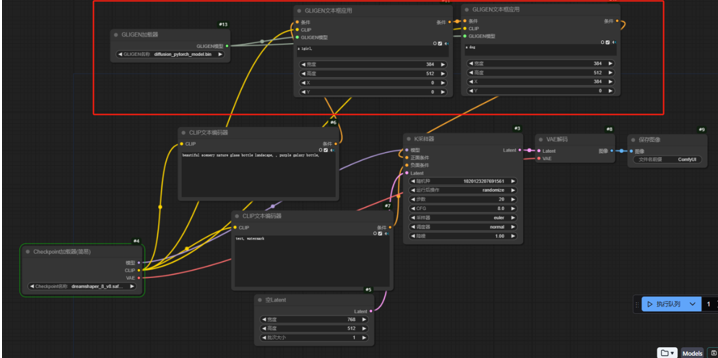

10、GLIGEN加载器

专门用来GLIGEN模型的,它可以指定某个区域生成特定的内容,实现文生图分区生成

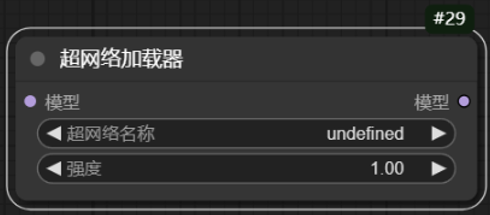

11、超网络加载器

其实就是hypernetwork模型的加载器,目前已经被lora模型所取代,用到的不多

12、放大模型加载器

加载放大模型

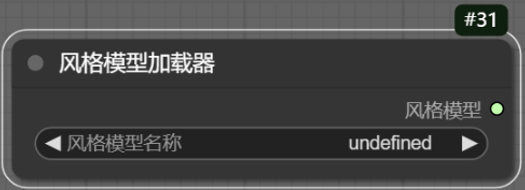

13、风格模型加载器

加载风格模型进行画面风格迁移

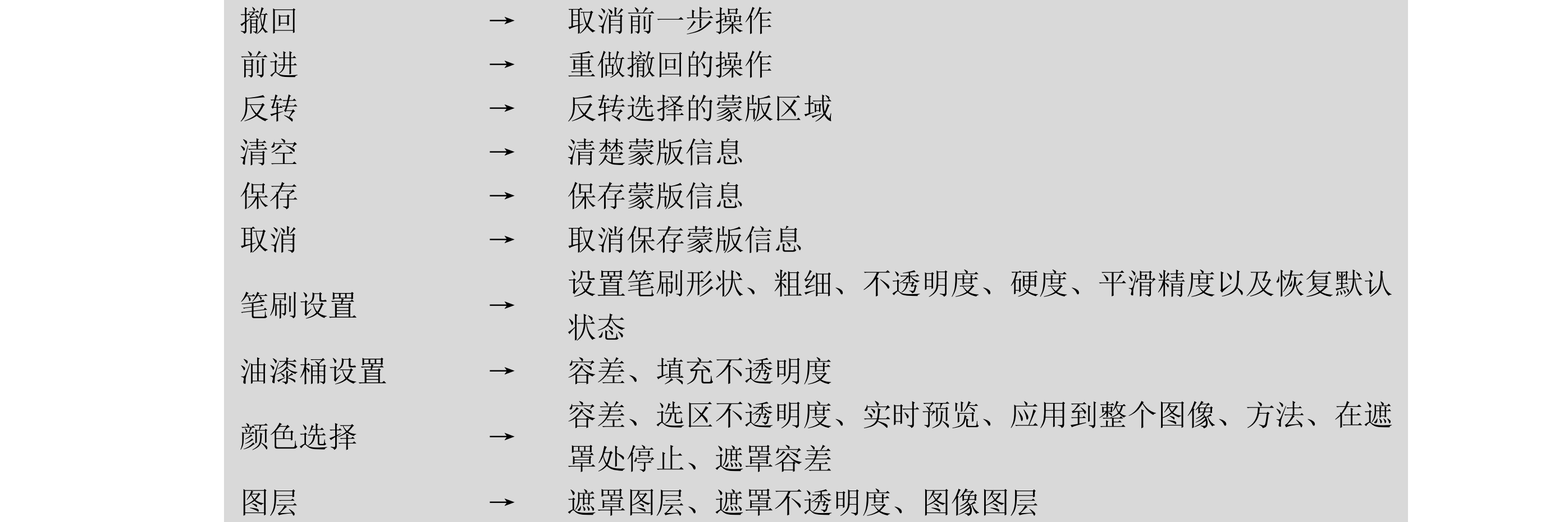

14、遮罩编辑器

遮罩编辑器目前是通过节点触发的。上传图片后,你可以右键点击节点,从菜单中选择打开遮罩编辑器,可以用鼠标点击图片来创建和编辑蒙版。